Công nghệ thế giới ảo siêu thực được chứng minh là một môi trường thực nghiệm hiệu quả để thử nghiệm khả năng điều khiển phương tiện an toàn trong các tình huống nguy hiểm, do đó được coi là trường dạy lái xe tốt nhất cho xe tự hành (AV).

Tesla, Waymo và các công ty phát triển xe tự hành chủ yếu dựa vào dữ liệu để kích hoạt các trình mô phỏng thực tế đắt tiền và độc quyền, vì việc thu thập dữ liệu và thử nghiệm tình huống quan trọng hoặc khẩn cấp thường không dễ dàng được thu thập hoặc không muốn sao chép.

|

|

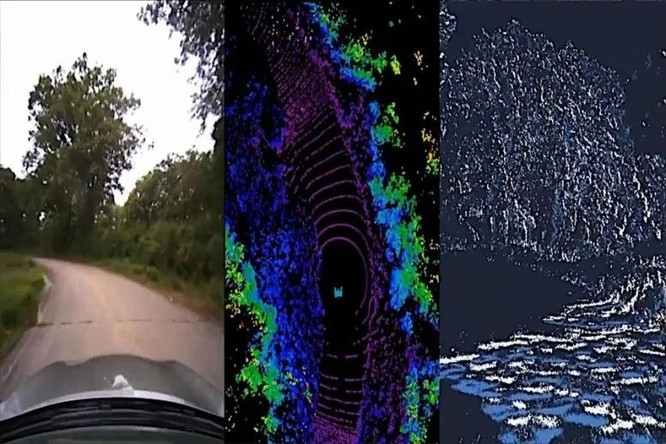

VISTA 2.0 là một công cụ mô phỏng mã nguồn mở có thể tạo ra một môi trường thực tế để đào tạo và thử nghiệm xe ô tô tự lái. Ảnh do MIT CSAIL cung cấp |

Với suy nghĩ này, các nhà khoa học từ Phòng thí nghiệm Khoa học Máy tính và Trí tuệ Nhân tạo (CSAIL) của MIT đã phát triển “VISTA 2.0”, một công cụ mô phỏng theo hướng dữ liệu, nơi các phương tiện tự hành có thể học cách lái xe trong thế giới thực và phục hồi sau các tình huống va chạm gần. Đặc biệt, tất cả phần mềm được phát hành dưới dạng mã nguồn mở cho công chúng.

Daniela Rus, giáo sư MIT kiêm Giám đốc CSAIL cho biết: “Hiện tại, chỉ có các công ty quy mô lớn mới có phần mềm và khả năng mô phỏng môi trường tương đương với VISTA 2.0 và là phần mềm độc quyền. Với mã nguồn mở mới được phát hành này, cộng đồng nghiên cứu có quyền truy cập vào một công cụ mới mạnh mẽ hỗ trợ thiết kế và phát triển các hệ thống điều khiển thích ứng có độ tin cậy cao. ô tô tự lái ”.

|

VISTA 2.0, một trình mô phỏng mã nguồn mở dành cho ô tô tự lái. Video MIT. |

VISTA là một trình mô phỏng thực tế, dựa trên cơ sở dữ liệu để lái xe tự hành. Phần mềm mô phỏng không chỉ video trực tiếp mà còn cả dữ liệu LiDAR và camera sự kiện, đồng thời kết hợp các phương tiện mô phỏng khác để mô phỏng các tình huống lái xe phức tạp. VISTA là mã nguồn mở cho tất cả các nhà sản xuất muốn phát triển hệ thống điều khiển xe không người lái.

VISTA 2.0, được xây dựng dựa trên mô hình mô phỏng trước đó của nhóm nghiên cứu. VISTA, về cơ bản khác với các trình mô phỏng AV hiện có vì nó xây dựng và hiển thị thực tế từ dữ liệu trong thế giới thực, cho phép chuyển đổi trực tiếp từ mô phỏng sang sử dụng thực tế.

VISTA 2.0 là hệ thống điều khiển dữ liệu có thể mô phỏng các loại cảm biến phức tạp và các kịch bản tương tác, nút giao thông trên quy mô lớn. Sử dụng ít dữ liệu hơn so với các mô hình trước đó, nhóm có thể đào tạo các phương tiện tự hành về cơ bản mạnh hơn những phương tiện được đào tạo trên cơ sở lượng lớn dữ liệu trong thế giới thực.

Alexander Amini, nghiên cứu sinh tiến sĩ tại CSAIL cùng với nghiên cứu sinh Tiến sĩ Tsun-Hsuan Wang, cho biết: “Đây là một bước tiến lớn trong mô phỏng theo hướng dữ liệu cho các phương tiện tự hành, cũng như sự gia tăng quy mô thông minh. sự tự tin và khả năng xử lý sự phức tạp của việc điều khiển xe tự hành. VISTA 2.0 thể hiện khả năng mô phỏng dữ liệu cảm biến vượt xa máy ảnh 2D RGB, màn hình 3D LiDAR độ phân giải cao với hàng triệu pixel, máy ảnh dựa trên sự kiện bất thường và thậm chí cả các kịch bản tương tác với các phương tiện khác. ”

Nhóm các nhà khoa học đã mở rộng mức độ phức tạp của các nhiệm vụ lái xe tương tác như vượt trước, đi sau, đàm phán vượt xe, để đưa vào các tình huống đa phương pháp trong môi trường. thực tế cao.

Hầu hết dữ liệu là việc lái xe thông thường, việc đào tạo mô hình AI cho xe tự hành liên quan đến nhiều loại tình huống nguy hiểm và tình huống bất thường, khó đoán định.

Trong mô phỏng, các phương tiện tự hành có thể di chuyển trong môi trường thực tế động, có các hệ thống điều khiển giao thông khác nhau, mô phỏng các loại sự kiện khác nhau, tạo ra các kịch bản phức tạp và tương tác với người dùng. có thể giới thiệu các phương tiện giao thông hoàn toàn mới, không có trong dữ liệu ban đầu.

Nhóm nghiên cứu đã thử nghiệm khả năng của hệ thống trong việc điều khiển xe tự lái chạy theo làn đường, rẽ làn, bám theo xe phía trước, di chuyển trên đường thật và các tình huống khó hơn như vượt tĩnh và động. (nhìn thấy chướng ngại vật và di chuyển xung quanh để không va chạm). Người điều hành người dùng có thể thêm các phần tử khác nhau vào các kịch bản và kiểm soát hoạt động của các phần tử này.

Hiện tại, ngoại trừ các kịch bản dựa trên cơ sở dữ liệu thời gian thực, VISTA 2.0 vẫn chưa thể mô phỏng cảm xúc của con người trên các làn đường giao thông. Đó là những hành động thân thiện hay không thân thiện, những hành vi khác nhau, những động tác huýt sáo hoặc chớp nhoáng đầy cảm xúc, là những loại sắc thái mà nhóm muốn hướng tới trong quá trình phát triển trong tương lai.

Tiến sĩ Amini giải thích: “Thuật toán trung tâm của nghiên cứu này là phương pháp lấy một tập dữ liệu và xây dựng một thế giới tổng hợp đầy đủ để tự động hóa học tập và đào tạo. Đây là nền tảng công nghệ có thể mở rộng theo nhiều hướng khác nhau trong lĩnh vực robot và tự động hóa. Phát hành VISTA 2.0 nhằm hỗ trợ cộng đồng thu thập các tập dữ liệu độc lập, chuyển đổi thành một thế giới ảo, nơi các nhà sản xuất có thể đào tạo và huấn luyện hệ thống điều khiển của các phương tiện tự lái trong thế giới này và sau đó có thể chuyển trực tiếp hệ thống sang các xe tự lái thực sự. ”

Theo SciTechDaily